Autovalores, Autovetores e Operadores#

Autovalores, Autovetores e Decomposição Espectral#

Autovalores e Autovetores#

Seja \(A\) um operador linear, com matriz na base computacional também representada por \(A\). Os autovalores de \(A\) são os números complexos \(\lambda\) que satisfazem

Os vetores não nulos \(\ket{v}\) que satisfazem a equação acima são chamados autovetores de \(A\) associados ao autovalor \(\lambda\).

Exemplo

O operador linear em 1 qubit \(Z\) definido pela matriz

possui:

autovalor \(1\), pois o vetor não nulo \(\ket{0}\) é tal que \(Z \ket{0} = 1 \cdot \ket{0}\);

autovalor \(-1\), pois o vetor não nulo \(\ket{1}\) satisfaz \(Z \ket{1} = -1 \cdot \ket{1}\).

Cálculo de Autovalores#

A equação de autovalores \(A \ket{v} = \lambda \ket{v}\) é equivalente a \(\big(A-\lambda I \big) \ket{v} = 0\), com \(\ket{v} \neq 0\), e isso é equivalente a dizer que a matriz de \(A-\lambda I\) é singular. Por sua vez, isso equivale à equação

Com a equação acima, consegue-se encontrar os autovalores \(\lambda\) do operador \(A\) encontrando-se as raízes do polinômio característico \((A-\lambda I)\). Esse polinômio têm grau \(n\) e, como estamos buscando raízes nos números complexos, admite \(n\) raízes (pode acontecer que sejam repetidas). Dessa forma, todo operador admite um autovalor (isso não é necessariamente válido para espaços vetoriais reais).

Exemplo

Os autovalores da matriz

podem ser obtidos por:

Os autovalores podem ser números complexos. Como a matriz é \(2\times2\), foi obtido um polinômio característico de grau 2 e foram obtidas 2 raízes.

Cálculo de Autovetores#

Uma vez descobertos os autovalores \(\lambda\), retorna-se à equação \(A \ket{v} = \lambda \ket{v}\), ou melhor, à equação

para encontrar todos os autovetores \(\ket{v} \neq 0\) satisfazendo essa equação. Como a matriz \(A-\lambda I\) é singular (essa é a condição para se encontrar \(\lambda\)), a equação em questão admite infinitas soluções \(\ket{v}\), formando um sistema linear possível e indeterminado.

Em algumas situações é possível montar uma base para o espaço composta por autovetores do operador \(A\). Há condições sobre o operador que revelam se é possível obter uma base ortonormal de autovetores. Isso será visto na seção Tipos Especiais de Operadores. A obtenção de uma base de autovetores permite escrever a matriz \(A\) nessa base como uma matriz diagonal, o que se prova útil em diversas circunstâncias.

Exemplo

Dada a matriz

os autovalores e autovetores são encontrados a seguir.

Autovalores: Resolvendo \(\det(X - \lambda I) = 0\), obtém-se:

\[\begin{split} \begin{array}{rcl} & & \det(X - \lambda I) = 0 \\ & & \det \begin{bmatrix} -\lambda & 1 \\ 1 & -\lambda \end{bmatrix} = 0 \\ & & \lambda^2 - 1 = 0 \\ & & \lambda = \pm 1 \ . \end{array} \end{split}\]Autovetores: Para cada autovalor \(\lambda\), deve-se resolver

\[ \big(X-\lambda I \big) \ket{v} = 0 \ , \]obtendo-se o vetor \(\ket{v}\).

Para \(\lambda = -1\):

\[\begin{split} \begin{array}{rcl} \big(X-\lambda I \big) \ket{v} &=& 0 \\ \begin{bmatrix} -1 & 1 \\ 1 & -1 \end{bmatrix} \begin{bmatrix} a_0 \\ a_1\end{bmatrix} &=& \begin{bmatrix} 0 \\ 0 \end{bmatrix} \end{array} \end{split}\]\[\begin{split} \begin{cases} -a_0 + a_1 = 0 \\ \phantom{-}a_0 - a_1 = 0 \end{cases} \end{split}\]O sistema resultante, como esperado, é possível e indeterminado. Resolvendo o sistema, tem-se:

\[\begin{split} \begin{cases} a_0 = a_1 \\ a_1 \in \mathbb{C} \ . \end{cases} \end{split}\]Os autovetores associados ao autovalor \(\lambda = -1\) são:

\[\begin{split} \ket{v} = \begin{bmatrix} a_1 \\ a_1 \end{bmatrix} = a_1 \begin{bmatrix} 1 \\ 1 \end{bmatrix} \ \ \text{ com } a_1 \in \mathbb{C}, a_1 \neq 0 \end{split}\]O autoespaço associado a \(\lambda = -1\) é o subespaço vetorial:

\[\begin{split} V_{-1} = \left\lbrace a_1 \begin{bmatrix} 1 \\ 1 \end{bmatrix} \colon a_1 \in \mathbb{C} \right\rbrace \ = \text{span}\left\lbrace \begin{bmatrix} 1 \\ 1 \end{bmatrix} \right\rbrace . \end{split}\]

Para \(\lambda = 1\):

O sistema é possível e indeterminado, e, resolvendo o sistema, tem-se:

Os autovetores associados ao autovalor \(\lambda = 1\) são:

O autoespaço associado a \(\lambda = 1\) é o subespaço vetorial:

Operadores#

Diagonalização de Operadores#

Uma vez encontrados os autovalores \(\lambda_j\) e uma base de autovetores \(\mathcal{V} = \{ \ket{v_j} , j=0, \ldots , n-1 \}\), com \(\ket{v_j}\) associado ao autovalor \(\lambda_j\), o operador linear \(A\) pode ser escrito na base \(\mathcal{V}\) como uma matriz diagonal. Defina as matrizes:

A matriz de \(A\) na base \(\mathcal{V}\) é dada por:

A matriz \(M\) nada mais é que a matriz de mudança de base \(M=[I]^{\mathcal{I}}_{\mathcal{V}}\). Conforme a seção Matriz de Mudança de Base , pode-se escrever:

Ainda, se a base \(\mathcal{V}\) for ortonormal, conforme Base Ortonormal, pode-se escrever

Nessas expressões, usa-se \(A\) para denotar a matriz \([A]\) do operador \(A\) na base computacional, o que simplifica a notação quando não houver risco de confusão.

Portanto, de posse dos autovalores e de uma base ortonormal, é possível escrever o operador \(A\) como uma matriz diagonal.

O operador \(A\) também pode ser representado na notação do produto exterior da seguinte forma. Como \(\mathcal{V}\) forma uma base ortonormal, vale a relação de completude \(I = \sum_k \ket{v_k}\bra{v_k}\) para essa base. Aplicando-se essa relação a \(A\), obtém-se

Exemplo

No exemplo Autovetores X foram calculados os autovalores e autovetores da matriz

obtendo-se:

\(\lambda = 1\phantom{-}\) , \(\ket{v} = a \begin{bmatrix} 1 \\ 1 \end{bmatrix}\) \(\phantom{-}\) \((`a \in \mathbb{C}, a \neq 0\))$

\(\lambda = -1\) , \(\ket{v} = a \begin{bmatrix}\phantom{-}1 \\ -1 \end{bmatrix}\) (\(a \in \mathbb{C}, a \neq 0\))

Pretende-se extrair uma base ortonormal de autovetores para escrever \(X\) na forma diagonal. Nesse caso (Todos os autoespaços de dimensão 1.), basta normalizar os autovetores obtidos.

Para \(\lambda = -1\):

\[\begin{split} \Big|\Big|{a \begin{bmatrix} 1 \\ 1 \end{bmatrix} }\Big|\Big| = 1 \implies |{a}| \sqrt{1^2 + 1^2} = 1 \implies |{a}| = \frac{1}{\sqrt{2}} \ . \end{split}\]Há várias opções para \(a\) que satisfazem essa condição. Pode-se escolher apenas uma delas para fazer a diagonalização, por exemplo: \(a = \frac{1}{\sqrt{2}}\). O autovetor normalizado é, portanto,

\[\begin{split} \ket{v} = \frac{1}{\sqrt{2}} \begin{bmatrix} 1 \\ 1 \end{bmatrix} = \frac{1}{\sqrt{2}} \ket{0} + \frac{1}{\sqrt{2}} \ket{1} \ . \end{split}\]Para \(\lambda = 1\):

\[\begin{split} \Big|\Big|{a \begin{bmatrix} \phantom{-}1 \\ -1 \end{bmatrix} }\Big|\Big| = 1 \implies |{a}| \sqrt{1^2 + (-1)^2} = 1 \implies |{a}| = \frac{1}{\sqrt{2}} \ . \end{split}\]Do mesmo modo, pode-se escolher \(a = \frac{1}{\sqrt{2}}\), e o autovetor normalizado é:

\[\begin{split} \ket{v} = \frac{1}{\sqrt{2}} \begin{bmatrix}\phantom{-} 1 \\ -1 \end{bmatrix} = \frac{1}{\sqrt{2}} \ket{0} - \frac{1}{\sqrt{2}} \ket{1} \ . \end{split}\]Base ortonormal de autovetores:

\[\begin{split} \underbrace{\ket{v_0} = \frac{1}{\sqrt{2}} \begin{bmatrix} 1 \\ 1 \end{bmatrix}}_{\lambda = 1} \ \ , \ \ \underbrace{\ket{v_1} = \frac{1}{\sqrt{2}} \begin{bmatrix}\phantom{-} 1 \\ -1 \end{bmatrix}}_{\lambda = -1} \end{split}\]Diagonalização da matriz:

Matriz de \(X\) na forma diagonal:

\[\begin{split} X_D = \begin{bmatrix}\lambda_0 & \\ & \lambda_1\end{bmatrix} = \begin{bmatrix}1 & \\ & -1 \end{bmatrix} \end{split}\]Matriz de mudança de base:

\[\begin{split} M = \begin{bmatrix} | & | \\ \ket{v_0} & \ket{v_{1}} \\ | & | \end{bmatrix} = \begin{bmatrix} \frac{1}{\sqrt{2}} & \frac{1}{\sqrt{2}} \\ & \\ \phantom{-}\frac{1}{\sqrt{2}} & -\frac{1}{\sqrt{2}} \end{bmatrix} = \frac{1}{\sqrt{2}} \begin{bmatrix} 1 & \phantom{-}1 \\ 1 & -1 \end{bmatrix} \end{split}\]Operador na forma diagonal: Na notação de produto exterior, tem-se:

Função de Operadores#

Como podemos calcular \(f(A)\), em que \(A\) é um operador? Vamos utilizar a série de Taylor

onde \(x_0\) é o ponto onde queremos expandir a função.

Exemplo

\(f(x) = e^x\) com \(x_0 = 0\):

Podemos estender essa ideia para operadores substituindo \(x\) por \(A\):

Usando a decomposição espectral de \(A\):

Calculando \(e^A\) via autovalores, subsituímos na série:

Portanto, de maneira geral, se \(f(x)\) puder ser expandida em série de Taylor, podemos definir a função de operador \(f(A)\) como:

Ou seja, basta aplicar \(f\) nos autovalores de \(A\)

Tipos Especiais de Operadores#

Nesta seção, alguns operadores com propriedades especiais serão apresentados. Os operadores normais, hermitianos, unitários, positivos e projetivos participam da base da Mecânica Quântica.

Operador Adjunto#

Seja \(A\) um operador linear. Em Álgebra Linear, é possível demonstrar que existe um único operador linear, denotado por \(A^{\dagger}\) e chamado operador adjunto de \(A\), que satisfaz a seguinte propriedade:

(OA1) \(\big( \ket{\phi} , A\ket{\psi} \big) = \big( A^{\dagger}\ket{\phi} , \ket{\psi} \big)\) Para qualquer base \(\beta\), a matriz do operador \(A^{\dagger}\) está relacionada com a matriz de \(A\) por

(OA2) \([A^\dagger ]_\beta = [A]_\beta^{\ \dagger} = \big( [A]_\beta^{\ *}\big)^{T}\) isto é, a matriz \([A]_\beta^{\ \dagger}\) é obtida de \([A]_\beta\) conjugando suas entradas e tomando a transposta.

Algumas propriedades da adjunta estão dispostas na seguinte lista:

\(\big( A^\dagger \big)^\dagger = A\) (Involução)

\(\displaystyle \left( \sum_k a_k A_k \right)^{\dagger} = \sum_k a_k^{\ *} A_k^{\ \dagger}\) (Antilinearidade)

Exemplo

A matriz adjunta de

é a matriz conjugada transposta

Operadores Normais#

Um operador é dito normal se comuta com seu operador adjunto:

(ON) \(A \cdot A^{\dagger} = A^{\dagger} \cdot A\)

Exemplo

O operador definido pela matriz

é normal, pois satisfaz \(A A^\dagger = A^\dagger A\). De fato,

e tem-se que

A importância do operador normal decorre do seguinte teorema:

Teorema Espectral

Um operador é normal se, e somente se, for diagonalizável.

Dessa forma, basta checar se um operador é normal para se saber se ele admite uma base de autovetores e uma representação por matriz diagonal.

Operadores Hermitianos ou Autoadjuntos#

Um operador \(H\) é dito hermitiano, ou autoadjunto se valer a seguinte propriedade:

(OH) \(H^{\dagger} = H\)

Exemplo

O operador dado por

é autoadjunto, pois

Os operadores hermitianos estão relacionados com a evolução no tempo de um sistema quântico fechado e com a medida de um observável.

Um operador hermitiano é, automaticamente, um operador normal, tendo em vista que \(H H^\dagger = H^2 = H^\dagger H\). Conforme o teorema Teorema Espectral: Operador Normal, todo operador hermitiano é, pois, diagonalizável. Além disso, há um teorema que permite tirar conclusões a respeito dos autovalores de uma matriz hermitiana.

Teorema Espectral para Matrizes Hermitianas

Um operador normal é hermitiano se, e somente se, todos os seus autovalores são reais.

Operadores Unitários#

Um operador \(U\) é dito unitário se satisfizer alguma das condições equivalentes:

(OU1) \(U^{\dagger} = U^{-1}\).

(OU2) As linhas ou as colunas de \([U]_\beta\) são vetores ortonormais em \(\mathbb{C}^n\), para alguma base \(\beta\).

(OU3) \(U\) é uma isometria, isto é, preserva o produto interno entre vetores (e em consequência, preserva também a distância entre vetores): \(\big( U\ket{\phi} , U\ket{\psi} \big) = \big( \ket{\phi} , \ket{\psi} \big)\).

Exemplo

O operador definido pela matriz

é unitário, pois as colunas \(\ket{c_0} = \frac{1}{\sqrt{2}}\begin{bmatrix} 1 \\ 1\end{bmatrix}\) e \(\ket{c_1} = \frac{1}{\sqrt{2}} \begin{bmatrix}\phantom{-}1 \\ -1 \end{bmatrix}\) são vetores ortonormais:

O produto de dois operadores unitários é unitário:

A condição de um operador ser unitário também implica normalidade, visto que \(U U^\dagger = I = U^\dagger U\). De acordo com o teorema Teorema Espectral: Operador Normal, todo operador unitário é, então, diagonalizável. Pode-se mostrar o seguinte teorema.

Teorema Espectral para Operadores Unitários

Seja \(U\) uma matriz normal. \(U\) é uma matriz unitária se, e somente se, os seus autovalores são números complexos de módulo 1, logo exprimíveis na forma \(\lambda = e^{i\theta}\) para algum \(\theta \in \mathbb{R}\).

Operadores Positivos#

Um operador é dito positivo quando satisfaz a seguinte propriedade:

(OPos) \(\bra{\psi}P\ket{\psi} \geq 0 \ , \ \ \forall \ket{\psi}\).

É possível demonstrar que um operador positivo é, automaticamente, hermitiano, e, portanto, todos os seus autovalores são reais. Além disso, a propriedade (OPos) é equivalente a dizer que todos os autovetores de \(P\) são números reais não-negativos \(\lambda \geq 0\).

Diz-se que um operador é positivo definido quando satisfaz a condição seguinte, mais rigorosas que (OPos):

(OPosDef) \(\bra{\psi}P\ket{\psi} > 0 \ , \ \ \forall \ket{\psi}\neq 0\)

Essa condição é equivalente a afirmar que todos os autovalores de \(P\) são números reais positivos \(\lambda >0\).

Exemplo

O operador definido pela matriz

é positivo. De fato, por se tratar de uma matriz triangular, os autovalores podem ser obtidos diretamente da diagonal: \(\lambda = 1\) e \(\lambda = 2\). Seus autovalores são todos não negativos, do que decorre que \(A\) é positivo. Como nenhum autovalor é nulo, o operador é também positivo definido.

Operadores de Projeção#

Um operador de projeção é um operador \(P\) que satisfaz:

(OProj) \(P^2 = P\).

Os autovalores de \(P\) podem assumir os valores \(\lambda = 0\) ou \(\lambda = 1\). De fato, se \(\lambda\) é um autovalor com autovetor \(\ket{v}\neq 0\) associado, tem-se \(P\ket{v} = \lambda \ket{v} \implies \lambda \ket{v} = P\ket{v} = PP\ket{v} = \lambda P\ket{v} = \lambda^2 \ket{v}\), logo, \((\lambda^2 - \lambda)\ket{v} = 0\) e, como \(\ket{v} \neq 0\), tem-se \(\lambda^2 - \lambda = 0\) e, por fim, \(\lambda = 0\) ou \(\lambda = 1\). Isso prova, em virtude dos teoremas Teorema Espectral: Operador Hermitiano e Teorema Espectral: Operador Unitário, que todo operador de projeção é hermitiano e positivo.

Considere o subspaço vetorial de dimensão finita \(W = P(V)\) (imagem de \(P\)). Seja \(k=\dim W\) e tome uma base ortonormal \(\big\{ \ket{v_0}, \ldots , \ket{v_{k-1}} \big\}\) de \(P(V)\). Estendendo-se a \(\big\{ \ket{v_0}, \ldots , \ket{v_{k-1}}, \ket{v_k} , \ldots , \ket{v_{n-1}} \big\}\) base ortonormal do espaço \(V\), é possível escrever o operador \(P\) como

O operador

é um operador de projeção no subespaço \(W^{\perp}\).

Tem-se que \(\text{Proj}_W + \text{Proj}_{W^\perp} = I\) e portanto, todo vetor \(\ket{\psi}\) pode ser decomposto na soma de projeções em \(W\) e em \(W^{\perp}\):

Exemplo

Os operadores no espaço de estados de 1 qubit

são as projeções na direção dos vetores \(\ket{0}\) e \(\ket{1}\), respectivamente. Tem-se que

que é a relação de completude.

Se denotarmos por \(W = \text{span}\{\ket{0} \}\) o subespaço gerado por \(\ket{0}\), tem-se que \(W^\perp = \text{span}\{ \ket{1} \}\), \(\ket{0}\bra{0} = \text{Proj}_W\), \(\ket{1}\bra{1} = I - \ket{0}\bra{0} = \text{Proj}_{W^\perp}\) e qualquer vetor \(\ket{\psi}\) pode ser escrito como

Se \(\ket{\psi} = a \ket{0} + b \ket{1}\), então

Resumo#

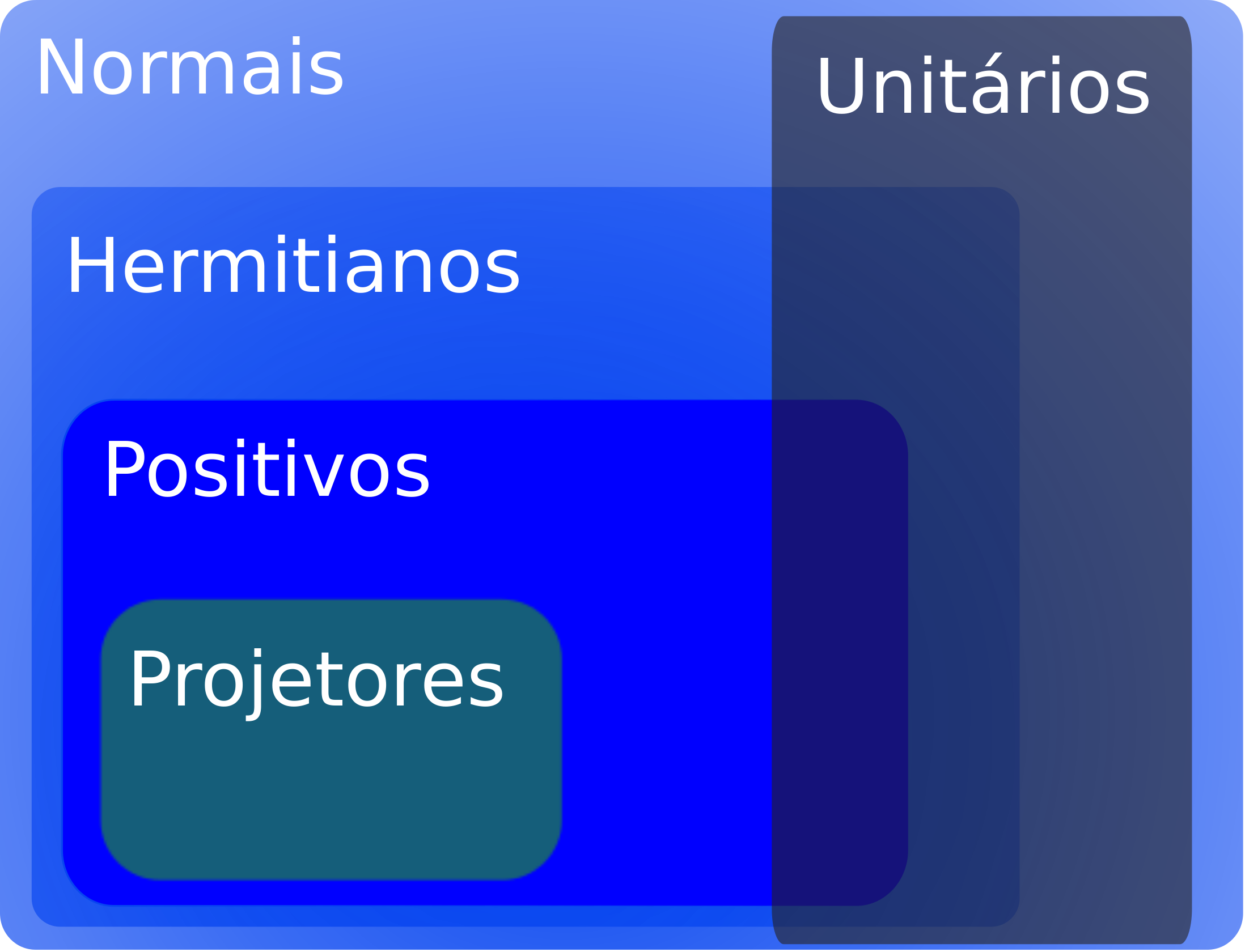

A figura abaixo traz um quadro resumo dos operadores especiais abordados neste capítulo.

Fig. 1 Relação entre os operadores especiais estudados neste capítulo. Fonte: Slides de Álgebra Linear, UFSM.#

Operador |

Propriedade |

|---|---|

Normal |

\(N N^\dagger = N^\dagger N\) |

Autoadjunto ou Hermitiano |

\(H^\dagger = H\) |

Unitário |

\(U^{-1} = U^\dagger\) |

Projetor |

\(P^2 = P\) |

Positivo |

\(\bra{\psi}P\ket{\psi} \geq 0 \ , \ \ \forall \ket{\psi}\) |

Positivo definido |

\(\bra{\psi}P\ket{\psi} > 0 \ , \ \ \forall \ket{\psi}\neq 0\) |